« Une pomme chaque matin éloigne le médecin », et si cela ne suffisait pas, l’iPhone 14 Pro est maintenant fourni avec une pilule. La « Dynamic Island », c’est son nom en-anglais-dans-le-texte, est d’autant plus visible que l’écran qui l’entoure reste toujours allumé. Mais ce n’est rien à côté des objectifs photographiques, qui grignotent encore un peu plus le dos de l’appareil.

Cette seizième révision annuelle n’est pas une révision anodine. L’écran toujours allumé promet de changer le rapport aux notifications, la Dynamic Island change fondamentalement le modèle d’interaction avec les applications, le « grand » capteur de 48 Mpx transfigure les clichés, et le prix atteint de nouveaux sommets. L’iPhone 14 Pro n’est pas un iPhone 13S Pro, mais devriez-vous l’acheter pour autant ? La réponse dans notre test.

Grand angle et grand capteur

Commençons par l’envers de l’iPhone 14 Pro. Si l’épaisseur du « plateau » (1,8 mm) et des objectifs (2,3 mm) représentent plus de la moitié de celle du corps (7,9 mm), au point de rendre l’appareil complètement bancal, c’est bien que le système photographique doit être important ! En prenant en compte cette bosse de plus en plus imposante, ce qu’Apple ne fait évidemment pas, l’iPhone 14 Pro est plus épais que l’iPhone original.

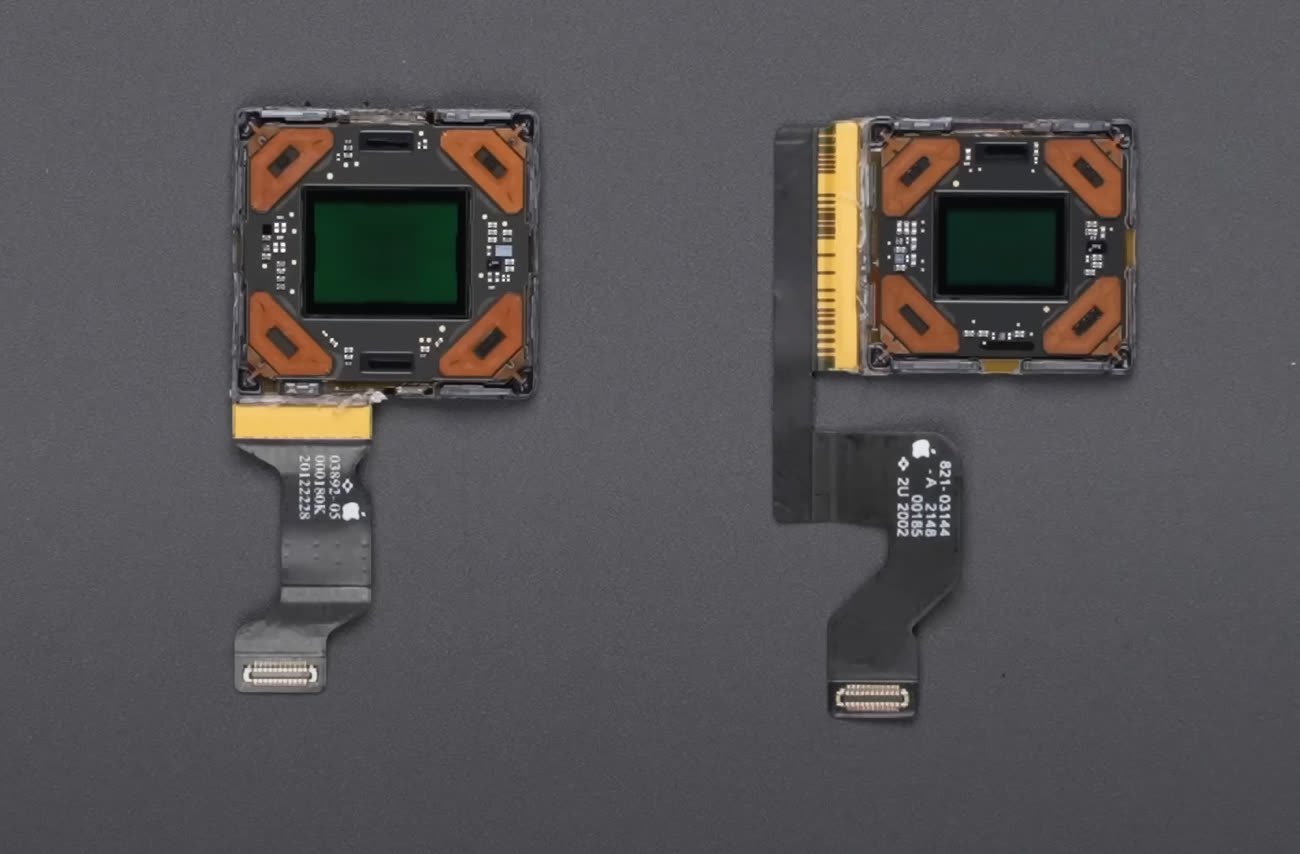

La justification est toute trouvée : les lois de la physique étant ce qu’elles sont, il faut augmenter le tirage pour agrandir le capteur sans changer la distance focale. Or Apple a sacrément agrandi le capteur de l’appareil grand-angle de l’iPhone 14 Pro1, presque deux tiers plus grand que celui de l’appareil grand-angle de l’iPhone 13 Pro, et plus grand même que le capteur de type 1/1,2 du Nokia 808 Pureview ! Apple vient chasser sur les terres des fabricants de compacts « experts ».

Rien ne permet d’améliorer la qualité des images aussi simplement et aussi sensiblement que l’agrandissement des photosites. Sauf que si ce capteur est deux tiers plus grand, il comporte aussi quatre fois plus de photosites, ce qui signifie que chacun d’entre eux est un tiers plus petit. Alors que le capteur principal de l’iPhone 13 Pro Max comportait douze-millions de photosites de 1,9 µm, celui de l’iPhone 14 Pro comporte quarante-huit-millions de photosites de 1,22 µm.

Comment Apple peut-elle se permettre d’affirmer que la qualité est « jusqu’à deux fois supérieure par faible luminosité » ? En recourant au binning : Apple regroupe quatre photosites pour former un quad-pixel, quarante-huit-millions de minuscules photosites de 1,22 µm deviennent douze-millions de gigantesques pixels de 2,44 µm, et les superlatifs peuvent pleuvoir (lire : Tout ce qu’il faut savoir sur le pixel binning, la combine pour améliorer les photos).

La réalité est plus complexe : l’interpolation des photosites introduit des artéfacts, et un quad-pixel ne capte pas autant qu’un véritable photosite de la même taille. Cela explique qu’Apple ait longtemps résisté au binning, employé de longue date par les fabricants asiatiques, avec des résultats plus ou moins heureux. Mais la firme de Cupertino conçoit ses propres processeurs et ses propres algorithmes de traitement, qui peuvent être intimement associés aux caractéristiques physiques du capteur.

Au lieu de traiter le quad-pixel comme un bloc, elle peut exploiter chaque photosite séparément, réduire la durée de l’exposition ici et augmenter la sensibilité là-bas, et recombiner les quatre signaux pour former un « super-pixel » optimal. Un quad-pixel n’est certes pas l’équivalent d’un photosite de 2,44 µm, mais ce n’est pas seulement la somme de quatre photosites de 1,22 µm. Encore heureux : l’optique ne sort pas indemne de l’opération, et perd un demi-diaph’, ce qui veut dire qu’elle laisse entrer un peu moins de lumière (ƒ/1,78) que celle de l’iPhone 13 Pro (ƒ/1,5).

En contrepartie, elle couvre un champ légèrement plus étendu. Apple desserre progressivement le cadre : de 35 mm dans les premiers modèles, puis 28 mm avec l’iPhone 4, et 26 mm depuis l’iPhone XS, la distance focale de l’optique principale tombe maintenant à 24 mm. C’est la limite pratique du « grand angle », qui permet de photographier un objet d’un mètre à un mètre de distance2 sans déformations excessives. Apple pourrait descendre jusqu’à 18 mm, la limite théorique couvrant un champ de 90°, mais la moindre (contre-)plongée déformerait fortement les verticales — et les visages.

Faut-il encore tester l’appareil principal en pleine journée ? L’iPhone 13 Pro produisait déjà des clichés fort satisfaisants. Il faut sortir la loupe pour discerner la moindre différence : les hautes lumières sont peut-être un peu moins bouchées, les tons moyens sont peut-être un peu moins chauds, les ombres sont peut-être un peu moins bruitées, et donc l’image est peut-être un peu plus détaillée. Les quad-pixels de l’iPhone 14 Pro ne valent pas quatre fois mieux que les pixels de l’iPhone 13 Pro.