S'il y a une fonction d'iOS 15 qui s'est révélée pratique au cours de l'année passée, c'est bien Texte en direct. D'un coup, l'iPhone est devenu capable de reconnaître le texte présent sur ses photos et de suggérer des actions appropriées : copier le texte, appeler le numéro de téléphone ou encore ouvrir le lien photographié.

Avec iOS 16, iPadOS 16 et macOS Ventura, Texte en direct devient encore plus puissant. La fonction devient plus largement disponible dans le système et ses actions annexes sont plus accessibles.

Texte en direct demande toujours un iPhone ou un iPad équipé d'une puce A12 au minimum (à partir des iPhone XS et iPad 8) ou n'importe quel Mac compatible avec macOS Ventura. L'analyse fonctionne avec les langues suivantes : français, anglais, chinois, italien, allemand, japonais, coréen, portugais, espagnol et ukrainien.

Texte en direct dans les vidéos

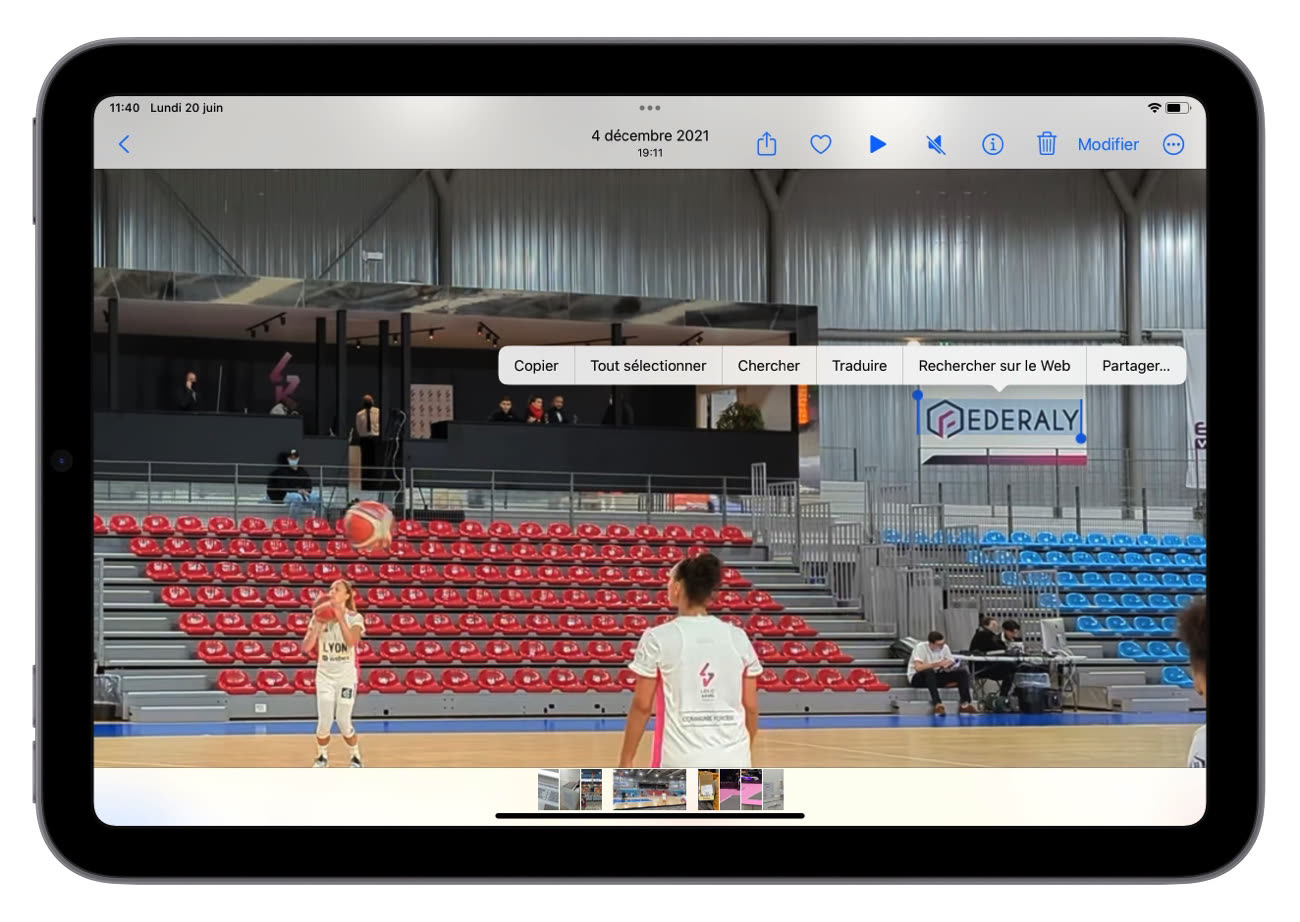

Première nouveauté de taille, Texte en direct n'est plus réservé aux images fixes, vous pouvez désormais vous en servir dans les vidéos. Pour cela, mettez sur pause la vidéo au moment le plus adéquat, puis touchez le texte que vous voulez copier ou utiliser d'une autre manière. Le menu contextuel habituel apparait alors pour copier l'extrait, faire une recherche sur le web, partager, etc.

Sur iPadOS 16, lorsque je fais des arrêts sur image dans une vidéo, je n'ai pas le bouton Texte en direct en bas à droite pour mettre en avant tout le texte analysé. En revanche, ce bouton apparait bien sur les arrêts sur image dans l'app Photos sur macOS Ventura. Il doit s'agir d'un bug de la première bêta d'iPadOS 16. Quoi qu'il en soit, même sans ce bouton, on peut sélectionner manuellement le texte analysé.