Siri est évidemment la voix de son maître, mais l'assistant d'iOS peut également être dupé et obéir à un autre… et ce, de manière silencieuse, par le biais d'un signal radio dans une zone de près de 5 mètres autour de l'iPhone. C'est la découverte de deux chercheurs français de l'ANSSI, José Lopes Esteves et Chaouki Kasmi, dévoilée début juin durant une conférence à Rennes mais qui a reçu peu de publicité jusqu'alors - l'histoire rebondit aujourd'hui, au travers d'un article publié par l'IEEE et sur Wired.

La manipulation touche aussi bien Siri que Google Now, et pour qu’elle fonctionne il est nécessaire qu’un casque ou des écouteurs et leur télécommande/micro soient connectés au smartphone. La bidouille exploite le cordon des écouteurs comme antenne, qui convertit des ondes électromagnétiques en signaux électriques qui fait passer des vessies pour des lanternes : en l’occurrence, le système d’exploitation est « trompé » et il croit entendre du son provenant du micro de l’utilisateur.

Sans avoir rien à dire, le forban peut prendre le contrôle de l’assistant pour passer des appels, envoyer des messages, utiliser le smartphone pour écouter discrètement la conversation de l’utilisateur, envoyer du spam sur Facebook ou Twitter… Bref, tout ce qu’il est possible de faire depuis Siri ou Google Now est aussi ouvert au truand mal intentionné (ou le collègue féru de blagues).

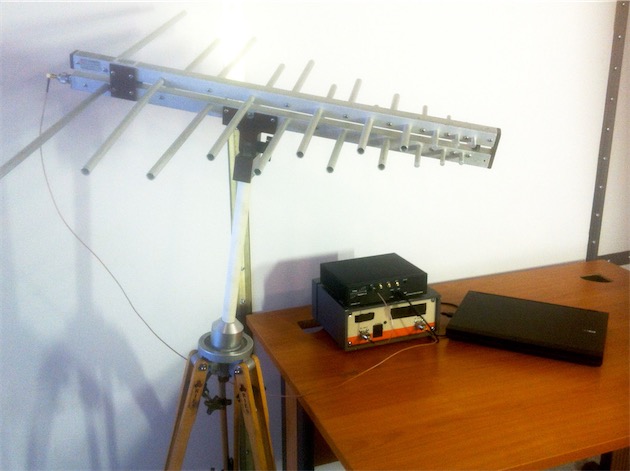

Le matériel à utiliser est abordable : un ordinateur portable équipé du logiciel open-source GNU Radio, une carte USRP, un amplificateur et une antenne — le transport de ces deux appareils qui peuvent être volumineux pourra se faire dans un sac à dos, mais dans ce cas la portée se limitera à 2 mètres. On peut la pousser à près de 5 mètres, mais il faudra alors investir dans un camion pour y loger une antenne suffisamment grande !

Les chercheurs ont réalisé une courte vidéo de démonstration avec comme victime Google Now, forcé d’ouvrir le site web de l’ANSSI. L’expérience a été réalisée dans une cage de Faraday pour des questions de réglementation, mais cette installation n’est pas nécessaire « dans la vraie vie ».

Depuis iOS 9, Siri n’est censé reconnaître que la voix de l’utilisateur (lire : Dans iOS 9, « Dis Siri » ne répond qu'à votre voix), mais notre expérience ici à la rédaction montre que les résultats sont assez aléatoires. Les chercheurs expliquent également qu’il n’est pas nécessaire que le mobile soit toujours à l’écoute (ce qui est le cas de l’iPhone 6s) pour perpétrer le forfait, même si cela le rend « moins complexe ».

Parmi les parades, les chercheurs expliquent que les victimes attentives peuvent se rendre compte de la manigance et reprendre la main sur leur iPhone… pour peu que les smartphones soient sous leurs yeux, évidemment. Une attaque organisée dans un lieu bondé (bar, aéroport…) par un brigand discret pourrait causer quelques dommages : tous les smartphones environnant le malfaiteur pourraient appeler par exemple des numéros surtaxés, à l’insu de leurs propriétaires.

Le meilleur moyen d’éviter ce type d’attaque, c’est encore de désactiver Siri depuis l’écran verrouillé (une option disponible dans Général > Touch ID et code > décochez Siri dans Autoriser l’accès en mode verrouillé).

L’ANSSI a contacté Apple et Google à propos de cette découverte. Les chercheurs proposent aux deux éditeurs de mettre au point un véritable système de « signature » vocale qui n’obéirait effectivement qu’aux seules injonctions de l’utilisateur.