Faites-vous confiance à vos objets connectés ? Si oui, vous pourriez vous en mordre les doigts, comme cette personne qui a vu des photos d'elle prise dans ses toilettes se retrouver sur Facebook… à cause d'un aspirateur robot. Le cas est un peu particulier, nous allons l'expliquer, mais montre qu'il y a parfois un problème de vie privée avec les objets connectés.

Un Roomba de développement qui pose des questions sur le partage des données

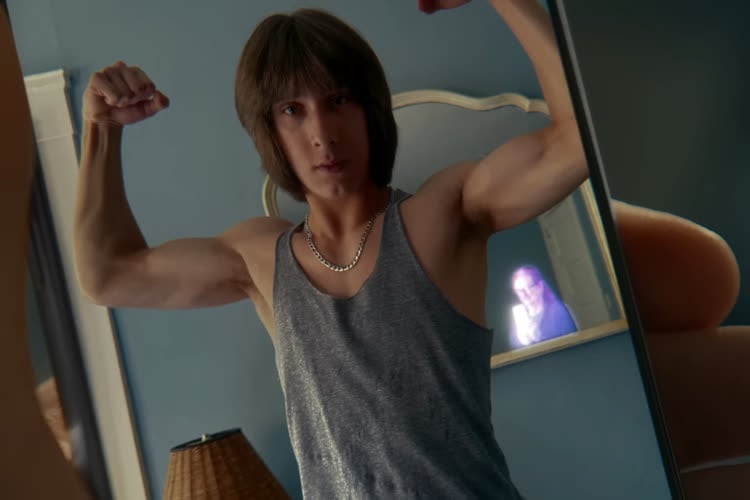

Les photos trouvées par MIT Technology Review sont un peu étonnantes : elles datent de 2020 et ont été prises au ras du sol, visiblement par un aspirateur robot Roomba de chez iRobot (une société rachetée par Amazon). Vous avez peut-être tiqué ici : les Roomba ne possèdent pas de caméras1. Et c'est bien le cas : les images proviennent d'une version de développement d'un modèle de la gamme J7, modifié pour prendre des photos chez des utilisateurs sélectionnés et dûment prévenus de cette possibilité.

Les images prises par ces robots particuliers servent en réalité à entraîner les IA qui permettent aux robots de se déplacer. iRobot travaillait avec la société Scale AI, spécialisée dans ce domaine. Et c'est là qu'un problème se pose.

Des humains voient les images

En théorie, les images ne devaient pas quitter les serveurs de Scale AI. En pratique, il y a un facteur humain qui intervient. Pour qu'une image soit assimilable par une IA, il faut qu'elle puisse déterminer le contenu de cette dernière, ce qui nécessite une mise en contexte avec des mots clés. Et actuellement, celle-ci est faite par des humains. Vous vous en doutez, cette tâche ne nécessite pas des compétences poussées et les sociétés sous-traitent donc cette partie à des travailleurs peu qualifiés qui — même s'ils signent des accords de confidentialité — ne suivent pas obligatoirement les règles.

Le résultat pratique, c'est que les photos « intéressantes » se retrouvent donc parfois sur des groupes Discord ou Facebook privés, et c'est là que MIT Technology Review a obtenu les siennes. Et comme le note le site, les personnes qui acceptent d'envoyer les images sur les serveurs ne se rendent pas toujours compte que ça implique souvent que des humains vont les regarder et (peut-être) les partager, même s'ils n'en ont pas le droit.

Des données nécessaires

Le souci principal, c'est que les fabricants d'aspirateurs robots ont besoin des données. Les modèles modernes, capables de cartographier le domicile, nécessitent des informations traitées correctement pour effectuer leur travail. Et chez iRobot, 95 % des images proviennent de véritables foyers. Selon la marque, les personnes qui fournissent ces dernières acceptent l'envoi et le partage des données, mais — comme dit plus haut — elles ne se rendent pas compte des risques. Les autres marques n'ont pas répondu ou affirment travailler avec des données issues de laboratoires ou de sociétés spécialisées (et donc pas de foyers de « vrais » utilisateurs).

En théorie, les images sont filtrées au niveau des serveurs, pour éviter que les collections comprennent des personnes dénudées, par exemple. Mais il semble que rien ne soit fait pour les captures qui montrent un visage. En effet, les fabricants indiquent qu'ils doivent entraîner les robots à détecter des humains et donc des visages. Et dans la même veine, les fonctions souvent un peu floues qui vous invitent à « Aider à améliorer les services » consistent parfois à envoyer des données captées par les robots à des sociétés spécialisées. Et bien évidemment, les CGU — que personne ne lit — restent assez évasives sur les données en question.

-

Plus exactement, pas de caméra accessible directement par l'utilisateur. ↩︎