Il est tard, les enfants sont couchés, c'est le bon moment pour tester Nude ! Cette application a une mission : conserver en lieu sûr, c'est à dire à l'abri des yeux indiscrets, toutes les photos et les vidéos un peu coquines que l'on peut prendre entre adultes consentants. L'app est un coffre-fort dans lequel on stocke des documents olé-olé provenant de la galerie photos de l'iPhone ou directement captés avec l'appareil photo.

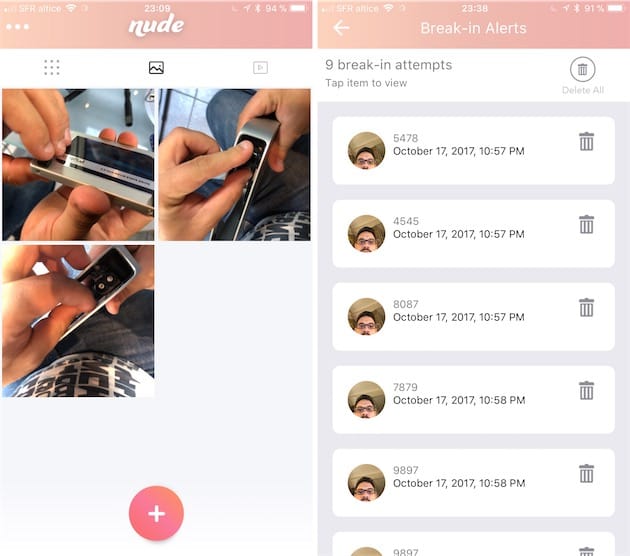

Les images peuvent ensuite être supprimées de la pellicule : les curieux ne pourront pas les consulter, l'application étant protégée par un code de verrouillage à quatre chiffres, ou Touch ID. Fini les moments gênants où un ami tombe par mégarde sur ce cliché un peu chaud, au beau milieu de photos de vacances innocentes. Quand un brigand tente de pénétrer par infraction dans l'app, celle-ci prend en douce des photos du maraudeur.

Mais la véritable innovation ici, c'est l'utilisation de CoreML, le framework d'apprentissage automatique mis au point par Apple dans iOS 11. Les auteurs de l'application ont gavé leur algorithme de 30 millions d'images (!) provenant de sites pornos. Ce dernier analyse automatiquement la bibliothèque photos de l'iPhone pour en extraire les documents canaillous. Tout cela se déroule bien sûr en local, et l'app donne toujours la possibilité de supprimer les photos de la pellicule du smartphone.

L'idée est épatante, amusante et somme toute utile. Sauf quand ça fonctionne mal : visiblement, Nude estime que des clichés bien innocents (vraiment !) d'un SSD sont NSFW. À la décharge de l'app, la galerie photos de l'iPhone de test ne contenait aucune image « adulte ». Les développeurs promettent d'améliorer leur moulinette. L'app ne présente aucune publicité, et son utilisation est gratuite pendant le premier mois. Il faudra ensuite s'y abonner, pour environ 1 € par mois.