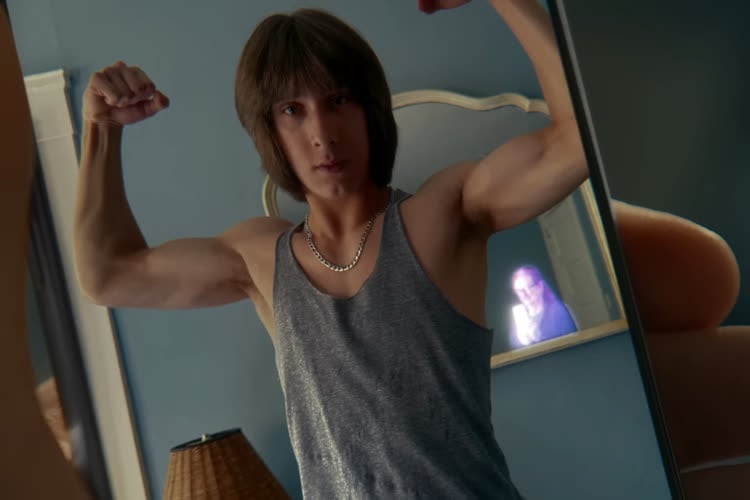

Voici une histoire qui résume bien toute la problématique des mesures des géants de la tech pour lutter contre le partage d'images pédopornographiques. Le New York Times rapporte que Mark, un père de famille américain, s'est retrouvé sous le coup d'une enquête policière après avoir pris des photos de son enfant à but médical. Son compte Google a été supprimé, ce qui lui a valu de perdre l'accès à ses e-mails, ses contacts, ses photos et même son numéro de téléphone (géré par l'opérateur mobile Google Fi). Malgré son innocence, Google refuse de lui rendre l'accès à son compte.

Au mois de février, ce père de famille américain a remarqué que le pénis de son tout-petit était bizarrement gonflé et lui faisait mal : il a donc décidé de prendre des photos de la zone infectée pour suivre l'évolution du problème. À la demande d'une infirmière, il a envoyé les clichés à un docteur en prévision d'une consultation en visio. Les photos ont circulé d'un téléphone Android jusqu'à un iPhone au sein de la famille, avant d'être envoyées sur le système de messagerie du prestataire médical. Le médecin a fini par prescrire des antibiotiques qui ont guéri l'infection.

En coulisse, la firme de Mountain View a identifié les images (automatiquement envoyées vers Google Photos) comme étant à caractère pédopornographique. Une vidéo de l'enfant a été transmise à la police de San Francisco, qui a ouvert une enquête. Mark a reçu une notification de Google deux jours après avoir pris les clichés lui indiquait que ses comptes avaient été verrouillés en raison d'un « contenu préjudiciable » qui constituait « une violation grave des règles de Google » et qui pouvait être illégal.

Dans le cadre de l'enquête, les policiers ont pu avoir accès à tout ce que stockait Mark sur les services de Google (historique de recherches, photos, lieux visités…). Le dossier a été clôturé quand la personne chargée de l'affaire a finalement conclu qu'aucun crime n'avait été commis. Une décision qui n'a visiblement pas suffi à Google, l'entreprise ayant refusé de rendre le compte de ce père de famille accusé à tort.

Le blocage de compte et la suppression de numéro de téléphone rendent difficile la connexion sur d'autres plateformes, qui nécessitent souvent un code à valider pour se connecter. Le New York Times précise qu'un enquêteur a essayé de contacter Mark par téléphone et par mail sans succès à la suite de ce blocage. Google reste sur sa position, un porte-parole explique à The Verge :

Nous nous conformons à la législation américaine pour définir ce qui constitue du CSAM (contenu pédopornographique) et utilisons une combinaison de technologie de correspondance de hachage et d'intelligence artificielle pour l'identifier et le retirer de nos plateformes. En outre, notre équipe d'experts en sécurité des enfants vérifie l'exactitude du contenu signalé et consulte des pédiatres pour s'assurer que nous sommes en mesure d'identifier les cas où les utilisateurs pourraient demander des conseils médicaux.

Les outils de Google se basent sur PhotoDNA, une technologie de Microsoft qui est utilisée par la majorité des sites. Celle-ci permet de scanner les images de manière automatisée sans avoir recours à la reconnaissance faciale. Google a lancé en 2018 une nouvelle API baptisée IA Content Safety API, ayant comme particularité de pouvoir détecter de façon proactive des clichés jamais vus auparavant.

Apple jusque-là en retard dans la lutte contre la pédopornographie

De son côté, Apple a dévoilé une fonction de détection d'images pédopornographiques dans la bibliothèque Photos d'iOS et iPadOS l'été dernier. Face à de nombreuses critiques, l'entreprise a en définitive repoussé ce projet. La dernière mouture d'iOS active cependant une fonction de floutage des photos sexuellement explicites dans Messages pour les utilisateurs mineurs. L'opération se réalise entièrement en local sur l'iPhone ou le Mac, et marche autant avec les SMS que dans les conversations iMessages.