Google Lens n’est plus une exclusivité des Pixel de Google. Cette technologie de reconnaissance d’images s’introduit dans les autres smartphones Android1 par le biais de l’application Google Photos et elle arrivera aussi sur iOS prochainement. En attendant la version iPhone, nous avons fait quelques essais avec un Galaxy S8+.

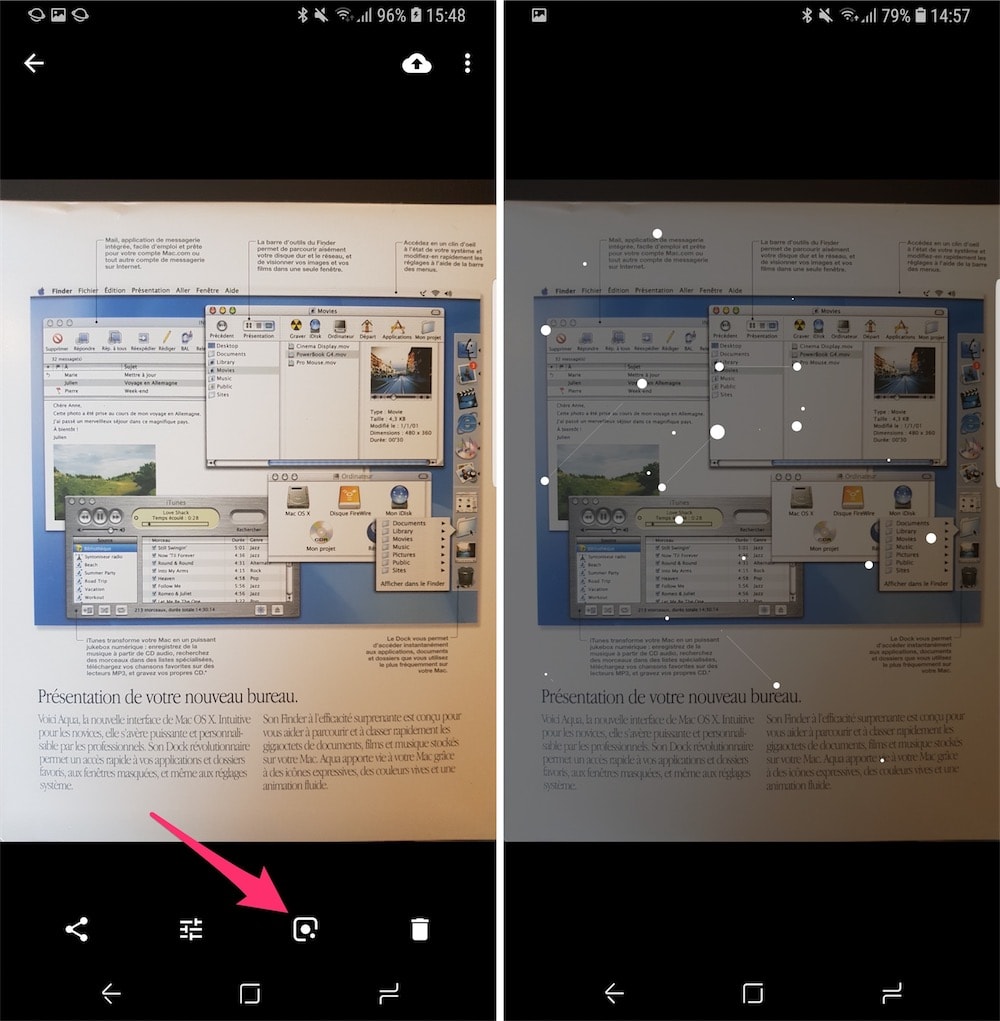

Après avoir touché le nouveau bouton dédié à Google Lens dans Google Photos, une animation reproduisant un réseau de neurones (des techniques d’intelligence artificielle sont à l’œuvre) s’affiche le temps que l’analyse s’effectue. Ensuite, l’application suggère différentes actions en fonction du contenu de la photo.

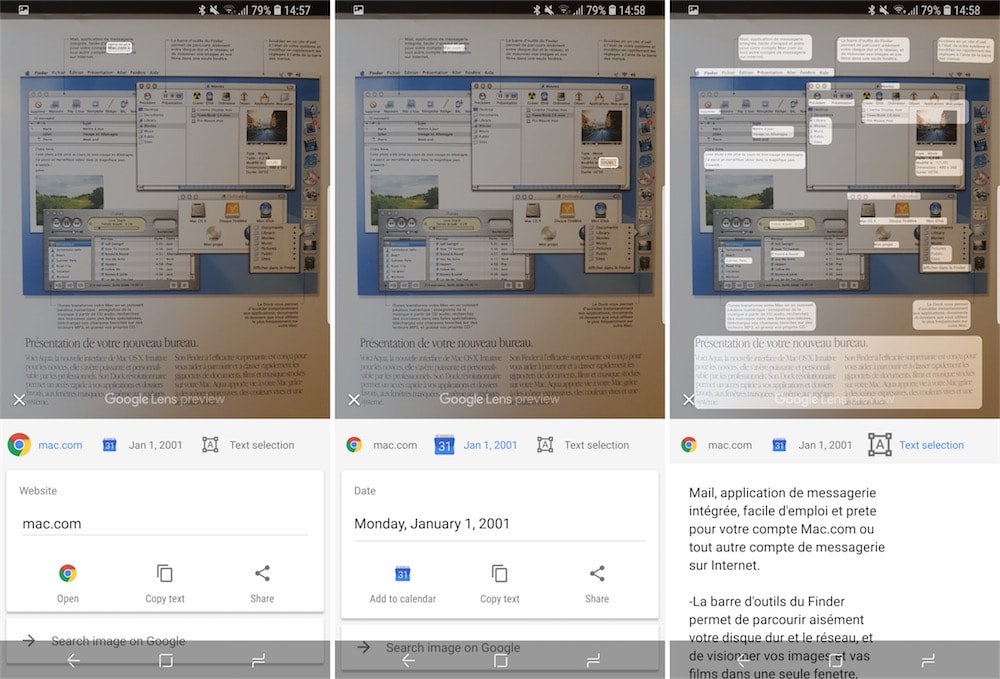

Dans l’exemple ci-dessous, à savoir la boîte de Mac OS X, l’application propose d’ouvrir une page web et d’ajouter un rendez-vous car une URL et une date ont été détectées. Google Lens a aussi extrait, de façon fiable, tout le texte figurant sur la boîte. Ce texte peut être copié et partagé librement.

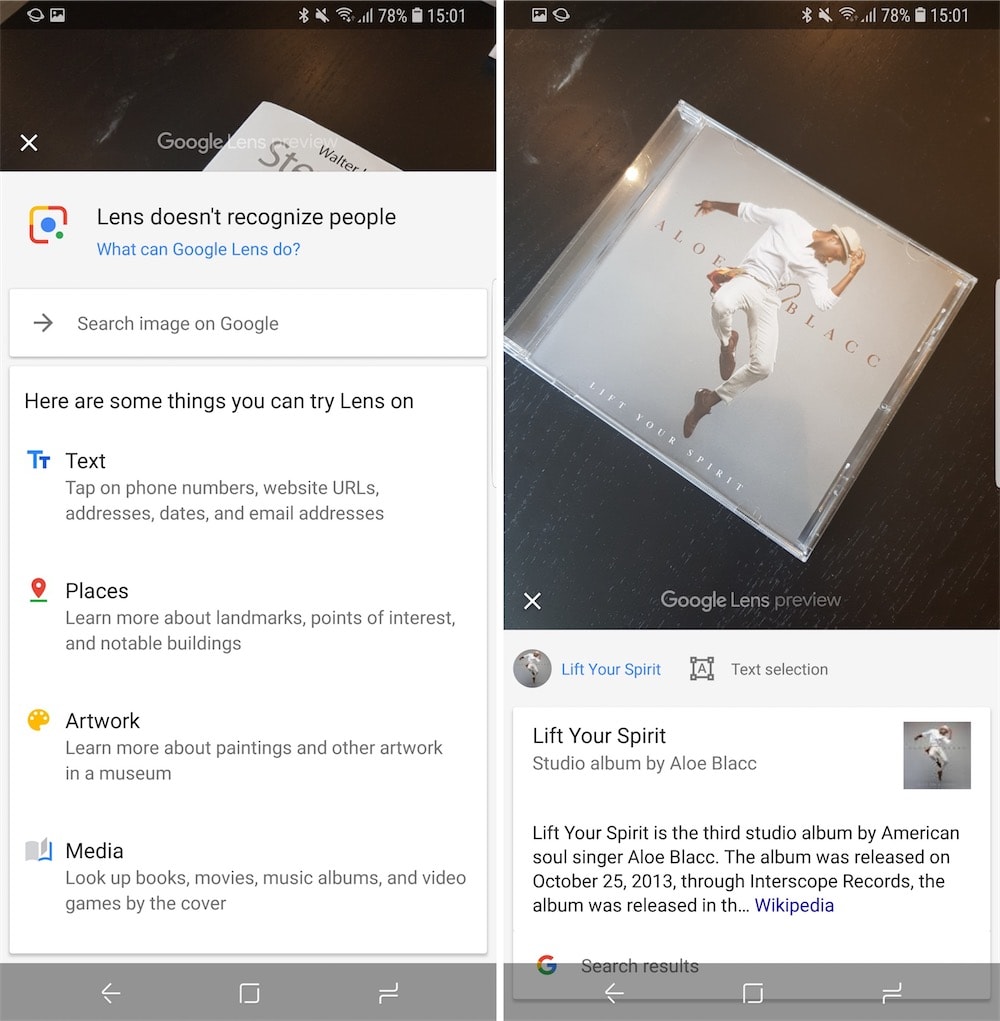

Google Lens peut aussi faciliter l’ajout d’un contact à partir d’une photo de carte de visite et donner des renseignements sur des points d'intérêt (des bâtiments célèbres comme de simples magasins), des œuvres d’art ou bien encore des couvertures de biens culturels.

Vous l’ignorez peut-être parce que le résultat est plus discret, mais iOS analyse également chaque photo que vous prenez avec votre iPhone. La reconnaissance de contenus d’Apple est utilisée dans le moteur de recherche de Photos (tapez « chapeau » et vous trouverez toutes les photos où apparaissent des chapeaux), pour créer les Souvenirs (les diaporamas photos) et pour identifier les personnes. Au moins une nouveauté tirant parti de l’intelligence artificielle serait en préparation pour Photos — l’application pourrait suggérer quelles images regarder —, mais elle n’arriverait pas avant 2019.

-

L’appareil doit être configuré en anglais et sous Android Oreo. Une connexion internet est également nécessaire. ↩︎