Sony a dévoilé deux nouveaux capteurs photo qui ont la particularité d'exécuter eux-mêmes les tâches liées à l'intelligence artificielle.

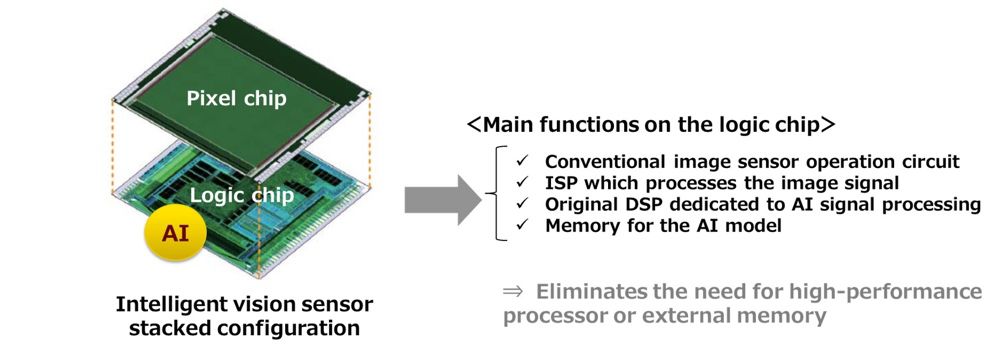

Jusqu'à maintenant, ces tâches, comme reconnaître les visages ou suivre un objet, étaient exécutées soit par le processeur de l'appareil, soit par une puce dédiée, soit par le cloud, c'est-à-dire des serveurs recevant les données et les interprétant.

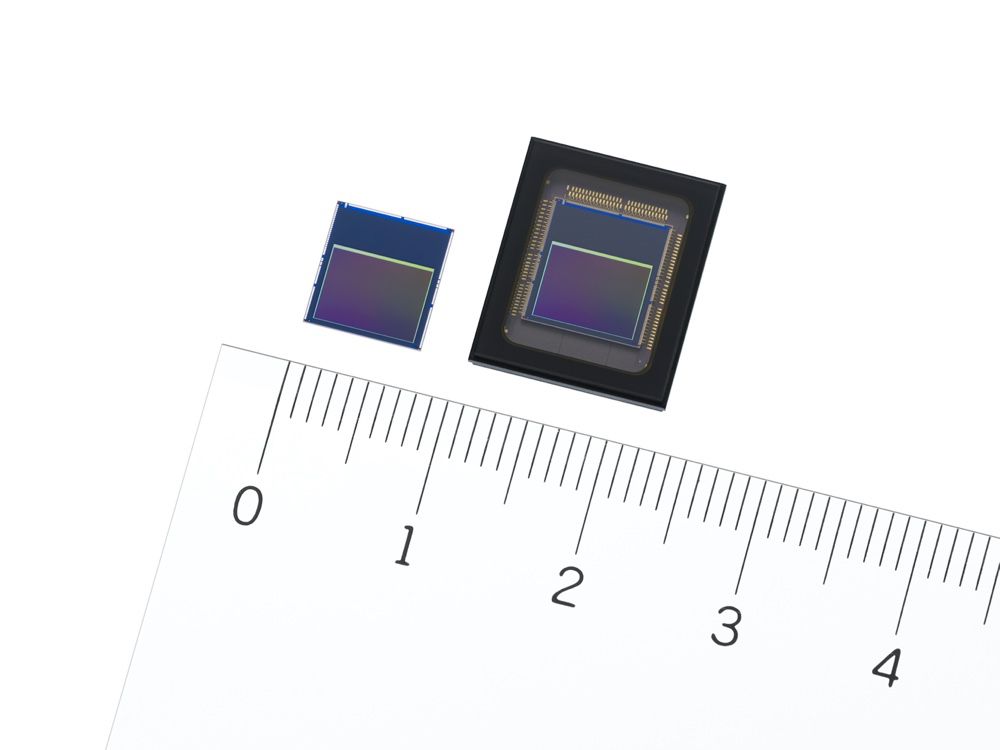

En collant une puce dédiée à l'IA au dos de ses capteurs photo, Sony permet d'exécuter ces tâches en local, avec un encombrement très réduit. Le fabricant japonais fournit plus de la moitié des capteurs d'image des smartphones dans le monde, y compris ceux de l'iPhone, ce qui laisse augurer une avancée du marché dans ce domaine.

Toutefois, les premiers capteurs dopés à l'IA, les IMX500 et IMX501, qui ont 12 mégapixels, ne sont pas destinés aux smartphones. Sony vise d'abord les industriels et la grande distribution, qui pourraient en tirer profit pour analyser les actions des clients (comme dans les boutiques Amazon Go) ou calculer automatiquement les stocks.

De plus, les capacités de ces capteurs sont limitées à l'heure actuelle : Mark Hanson, le directeur de l'innovation de Sony, a déclaré à The Verge qu'ils fonctionnaient uniquement avec des algorithmes assez « basiques ».

Dans les iPhone, le Neural Engine des puces Ax, capable d'effectuer plus de 1 000 milliards d’opérations d'apprentissage automatique à la seconde dans sa dernière version, a sans doute encore de beaux jours devant lui.